Introduction

L’intelligence artificielle entre dans une nouvelle ère avec l’arrivée de GLiBi, une version révolutionnaire du modèle GPT développée par OpenAI, spécialisée dans l’interprétation des contenus visuels. Contrairement aux modèles textuels classiques, GLiBi est capable de voir, comprendre, analyser et interagir avec des images, ouvrant ainsi des perspectives inédites dans de nombreux domaines.

Qu’est-ce que GLiBi ?

GLiBi est le fruit d’une évolution majeure des modèles de langage de type GPT (Generative Pre-trained Transformer). Alors que GPT-3.5 et GPT-4 étaient centrés sur la génération et la compréhension de texte, GLiBi intègre une vision multimodale : il peut traiter à la fois des images et du texte, de manière contextuelle et cohérente.

Concrètement, GLiBi repose sur une architecture multimodale combinant le traitement du langage naturel (NLP) et de la vision par ordinateur (Computer Vision). Cela signifie qu’il est capable de comprendre le contenu d’une image, d’identifier les objets, de lire le texte présent dans les images (OCR), de reconnaître les émotions, de proposer des suggestions graphiques, et d’y répondre comme s’il “comprenait” réellement ce qu’il voit.

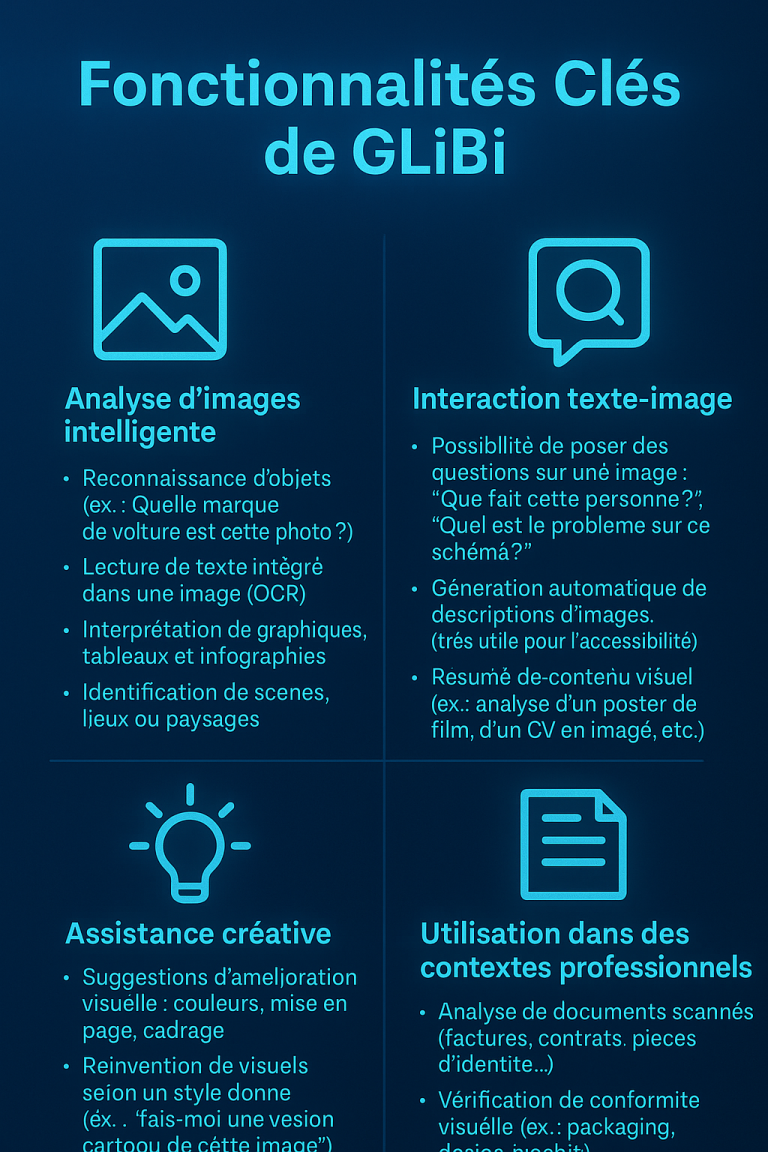

Fonctionnalités clés de GLiBi

Voici quelques-unes des fonctionnalités les plus impressionnantes de GLiBi :

- Analyse d’images intelligente

- Reconnaissance d’objets (ex. : “Quelle marque de voiture est sur cette photo ?”)

- Lecture de texte intégré dans une image (OCR)

- Interprétation de graphiques, tableaux et infographies

- Identification de scènes, lieux ou paysages

- Interaction texte-image

- Possibilité de poser des questions sur une image : “Que fait cette personne ?”, “Quel est le problème sur ce schéma ?”

- Génération automatique de descriptions d’images (très utile pour l’accessibilité)

- Résumé de contenu visuel (ex : analyse d’un poster de film, d’un CV en image, etc.)

- Assistance créative

- Suggestions d’amélioration visuelle : couleurs, mise en page, cadrage

- Réinvention de visuels selon un style donné (ex. : “fais-moi une version cartoon de cette image”)

- Création de prompts à partir d’une image pour la générer dans DALL·E ou Midjourney

- Utilisation dans des contextes professionnels

- Analyse de documents scannés (factures, contrats, pièces d’identité…)

- Vérification de conformité visuelle (ex : packaging, design produit)

Lecture automatique d’annotations manuscrites

Cas d’usage de GLiBi

Voici quelques exemples concrets :

- Éducation : un enseignant peut envoyer une carte ou un schéma, et GLiBi aide à l’expliquer de manière interactive à l’élève.

- E-commerce : un site peut automatiser la génération de description de produits à partir d’une simple photo.

- Marketing & Design : les graphistes peuvent obtenir des conseils de composition à partir de leurs propres créations.

- Santé : une IA peut analyser une radiographie (à usage expérimental pour l’instant).

Journalisme : analyse automatique d’images d’actualité pour en extraire les éléments clés.

Exemples similaires à GLiBi

GLiBi n’est pas seul sur ce terrain de l’IA multimodale. Voici quelques autres modèles et outils qui s’en rapprochent :

- Gemini (ex-Bard) de Google

Gemini 1.5 est un modèle multimodal capable d’analyser du texte, des images, de l’audio et même des vidéos. Il est aussi performant dans l’analyse de documents complexes ou d’images scientifiques.

- Claude 3 (Anthropic)

La série Claude peut également traiter des documents contenant des images, notamment pour faire de l’analyse ou de la classification.

- Grok (xAI – Elon Musk)

Utilisé sur X (Twitter), Grok commence à intégrer des fonctionnalités visuelles, bien que moins poussées que GLiBi ou Gemini pour le moment.

- DALL·E 3 (OpenAI)

Bien qu’il soit un générateur d’images, DALL·E 3 travaille en lien avec GPT-4 et permet de modifier des images ou en créer à partir d’un prompt — GLiBi peut générer ce prompt en analysant une image existante.

Ce que GLiBi change pour les créateurs de contenu

Pour les développeurs, designers, photographes ou formateurs, GLiBi ouvre un champ d’outils semi-automatisés ultra-puissants. Plus besoin de tout faire manuellement : on peut, par exemple, :

- Générer une légende Instagram cohérente à partir d’une photo.

- Réécrire une affiche à partir de son image pour une autre cible.

- Traduire les visuels d’un flyer en plusieurs langues.

Corriger un devoir à partir de la photo du cahier d’un élève.

Conclusion : GLiBi, vers une IA plus "humaine" ?

GLiBi n’est pas simplement une mise à jour : c’est une rupture technologique. L’intégration native de la vision dans GPT le rend bien plus proche de notre mode de compréhension du monde. Une IA qui voit, qui lit, qui comprend et qui parle… c’est une IA capable de collaborer.

Et ce n’est qu’un début. Les prochaines versions pourraient intégrer des vidéos, des mouvements, des sons… rendant l’intelligence artificielle plus immersive et plus utile que jamais.